Published: 23.04.2026

Připište si poslední kilometry do výzvy Rozhýbejme univerzitu netradičně – orientačním během v prostředí kampusu UPCE. Trať je navržena tak, aby byla vhodná jak pro běh, tak pro svižnou chůzi a zvládli ji i úplní začátečníci. O den později se pak společně vydáme na procházku s rektorem prof. Liborem Čapkem podél Labe zakončenou setkáním v loděnici, kde bude pro všechny účastníky připraveno drobné pohoštění.

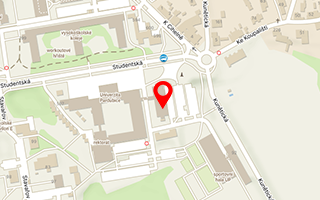

Orientační běh v kampusu – úterý 28. 4., 9:00–14:00

Sraz / start: pod tělocvičnou KTS

Trať měří přibližně 2 km a start je možný kdykoliv během konání akce. Není potřeba žádné speciální sportovní vybavení ani výkonnost – důležitá je chuť se hýbat a vyzkoušet si něco nového. Akce je otevřená všem studujícím i zaměstnaným, bez ohledu na zkušenosti s orientačním během.

doc. Ing. Petr Nachtigall, Ph.D.

Rozhýbejme univerzitu s rektorem – středa 29. 4., 16:00

Start: Vestibul KTS

Zveme všechny zapojené studující i zaměstnané. Přijďte symbolicky uzavřít letošní ročník, potkat se s ostatními účastníky a užít si společný pohyb v neformální atmosféře.

Katedra tělovýchovy a sportu