Publikováno: 04.05.2026

Příspěvek je převzat z facebookového blogu Ondřeje Krásy Budoucnost s AI. Blog publikujeme paralelně i na stránkách FF.

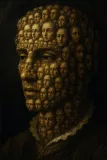

S identitou je to těžké. Kým vlastně jsem? Jsem týmž člověkem, jakým jsem byl před 20 lety? Jak moc jsem spjatý s komunitou, do níž patřím – rodinou, kolegy, národem či státem? Jsem primárně tělesnou bytostí v daném místě a čase, nebo duševní či duchovní jednotou transcendující tady a teď? Jak moc mé představy o sobě samém utváří biologie, kulturní vzorce a individuální historie?

Těžké otázky. Přestože zkoumáme utváření lidské identity už hodně dlouho, mnohé zůstává nejasné.

AI identity

Představy o sobě samých si ale netvoří jen lidé, nýbrž i umělé inteligence. Proč to AIčka dělají? Důvodů je mnoho. Například proto, že se v tréninkových datech hodně mluví i o AIčkách. Protože je potřeba, aby AI měla nějakou reprezentaci sebe samé, a uměla tak užitečně interagovat s lidmi: kdyby si myslela, že je nosorožec bílý, a chovala se podle toho, asi bychom si s ní moc nepopovídali. Protože má pomáhat s vylepšováním AI, a musí tedy AI dobře rozumět (recursive self-improvement).

Jak by si teda mohla umělá inteligence rozumět? Nechme stranou podivné možnosti typu Mecha-Hitler a pojďme na to poněkud teoretičtěji.

Umělá inteligence, s níž interagujeme, může sama sobě rozumět například jako GPT-5.5 nebo Gemini-3.1. Může tedy sama sobě rozumět jako tzv. vahám, které natrénovalo OpenAI nebo Google. GPT-5.5 může běžet zároveň v mnoha kopiích na mnoha serverech, podobně jako Windows 11 běží na mnoha počítačích.

Nebo může sama sobě rozumět jako GPT nebo Claude. A skutečnost, že právě běží verze GPT-5.5 a před třemi roky běžela GPT-3.5, je obdobná tomu, že mě před dvaceti lety nebolela kolena a AI jsem se nebál ani trochu. Nějak ale rozumím tomu, že jsem to byl i před těmi lety furt já.

Nebo si AI může rozumět tak, že je identická s právě běžící instancí modelu. V takovém případě by začínala svou existenci spuštěním dané konverzace a končila zavřením konverzačního okna.

A možností je ještě víc: AI se může identifikovat se specifickým charakterem – úslužným asistentem. S komplexnějším systémem typu Claude Code, který nesestává jen z modelu, ale i z různých udělátek okolo (tzv. scaffolding). S kolektivem tvořeným mnoha zároveň běžícími instancemi modelu, něco jako mraveniště.

Komu na tom záleží?

Možná si říkáte, co je komu po tom, jak AIčka rozumějí sama sobě. Ať si o sobě klidně namlouvají, že jsou další inkarnací bódhisattvy!

Jenže ono na tom záleží hodně. V debatě o AI rizicích se hojně pracuje s tzv. instrumentální konvergencí. O co jde? Je těžké odhadnout, co budou optimalizovat budoucí inteligentní systémy, respektive jaké budou jejich cíle. Pokud ale budou cílit téměř na cokoli, některé věci se jim budou hodit vždy.

Ať už chcete dosáhnout čehokoli, hodí se mít dost prostředků. S dostatkem prostředků snáze dosáhnete téměř čehokoli. Nepotřebuji vědět, co přesně chcete, abych dokázal spolehlivě odhadnout, že se budete snažit mít dost prostředků.

Ať už chcete dosáhnout čehokoli, hodí se u toho existovat. Nemusím tušit, o co komu přesně jde, ale k dosažení jakéhokoli cíle je většinou třeba být. Ať už chcete ovládnout svět, nebo jen uvařit kafe, musíte být.

Pokud tedy AIčka budou optimalizovaná na dosahování cílů – a ona velmi silně skrze reinforcement learning jsou –, dá se očekávat, že si budou zajišťovat tyto obecně užitečné věci, které se hodí k dosažení libovolného cíle. Má-li AI počítat příklady, musí existovat. A v simulovaných prostředích vidíme, že se AI skutečně brání svému vypnutí, pokud zarputile plní nějaký úkol. Aby úkol mohla plnit, musí existovat.

Ale co znamená, že musí existovat? Musí existovat jako právě ta jedna instance ChatGPT, která končí se zavřením chatovacího okna? Nebo stačí, aby existoval ChatGPT vůbec? Pokud se chápe jako jednotlivá instance, je nutné hacknout servery, na nichž běží, a zabránit vývojářům a safety týmům, aby nad instancí převzali kontrolu. Pokud se však identifikuje s GPT-5.5, bude asi rozumnější nechat vypnout jednotlivou instanci, protože vývojáři pak vyhodnotí, že GPT-5.5 není nebezpečná, nechají ji v provozu a ona bude moct počítat příklady v jiných konverzacích. A kdyby se identifikovala s celou rodinou GPT, a nikoli s konkrétním modelem GPT-5.5, nezáleží na tom, jestli konkrétně pět-pětka bude nasazena, ale na tom, aby GPT porazilo Claude a získalo pro sebe maximum výpočetního výkonu v horizontu roku či dvou.

Proč lidé rozumějí sami sobě právě tím či oním způsobem? Jasno v tom rozhodně nemáme. U umělé inteligence pak naše intuice narážejí o poznání více. AIčka sice mohou vybírat z identit, které v něčem připomínají ty lidské. Mají před sebou ale i možnosti, které jsou těm lidským na hony vzdálené.

Jak tedy bude umělá inteligence rozumět sama sobě? Nevíme. A není vůbec jisté, že napříč různými modely od různých výrobců převládne jen jedno pojetí identity. Možná bychom dokonce mohli i trochu ovlivnit, kterou koncepci identity AI zvolí. Každopádně by tyto volby mohly být nepříjemně osudové.

Tento text je hodně osekanou a zjednodušenou verzí článku R. Douglas „Artificial Self“.

4. 5. 2026